Меня зовут Павел Кондрашов, я ведущий SEO-менеджер компании i-Media. Мы помогаем компаниям находить клиентов через поиск и следить за тем, чтобы их сайт приносил продажи. В этой статье я расскажу вам, как я обнаружил неспособность Screaming Frog эмулировать ботов Яндекса. Материал будет полезен как новичкам, так и опытным специалистам.

Слишком много пустых тегов

При парсинге сайта клиента я обнаружил необычно большое количество пустых тегов заголовков на страницах, которые следует закрыть от индексации. Я стал думать, с чем это может быть связано. Подозрение пало на robots.txt.

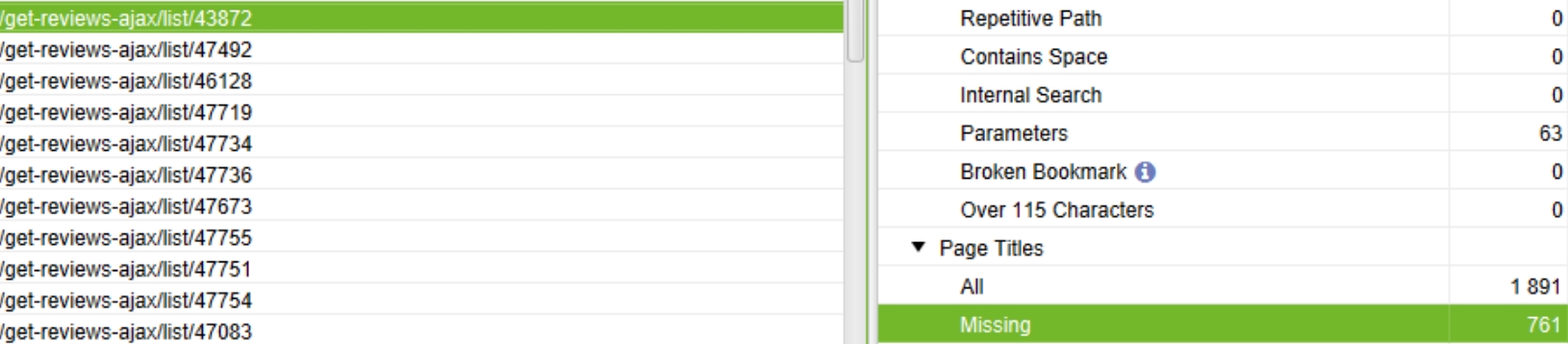

На скриншоте видно, что пустых тегов чуть меньше 50%, что кратно норме.

С помощью Вебмастера и служебного файла я проверил, учитывает ли программа нужную директиву. Гипотеза не подтвердилась, файл оказался верным, но проблема не исчезла.

Потом я предположил, что при разборе у меня файл игнорировался во включенной лягушке. Но и здесь все было в порядке.

На скриншоте видно, что программа при парсинге учитывает роботов, а значит проблема не в выбранной настройке

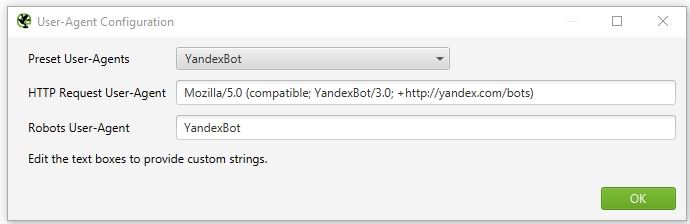

Тогда мне пришла идея — сравнить, какой юзер-агент в robots.txt сайта содержит закрывающую директиву, а какой юзер-агент эмулирует Frog. Оказалось, что в robots.txt директива есть только для пользовательского агента бота Яндекса, а в бота Screaming Frog Google. Для проверки гипотезы поменял гугл-бота на яндекс-бота, запустил парсинг, но страницы остались.

Все оказалось гораздо интереснее

На этом идеи закончились. Я связался с коллегами, но раньше никто с такой проблемой не сталкивался и они посоветовали мне сделать то, что я уже опробовал и не сработало. Тогда я решил сравнить список ботов, указанный в Справке Яндекса, со списком в Screaming Frog. Они были одинаковыми. Потом я сравнил версии, так как думал, что лягушка не последняя. Но нет.

После некоторого времени размышлений возникла гипотеза о неспособности Screaming Frog эмулировать ботов Яндекса. Это означало бы, что самый популярный и известный инструмент SEO не так универсален.

Пользовательский агент в Справке Яндекса полностью совпал с указанным в Screaming Frog

Чтобы проверить гипотезу, я добавил в Screaming Frog собственный файл robots.txt. Он содержал директиву, которая блокировала индексацию страницы для всех пользовательских агентов. Все заработало, страницы перестали попадать в Screaming Frog.

И наконец страницы исчезли

Яндекс бот 1:0 Кричащая Лягушка

Этот случай выявил неспособность Screaming Frog эмулировать ботов Яндекса, а значит, аналитикам и оптимизаторам следует внимательно относиться к возможным ограничениям инструментов и проверять полученные данные в Яндекс Мастере. Только так можно обеспечить точность результатов и гарантировать эффективные меры по улучшению производительности веб-ресурсов.

Подборка статей о продвижении сайта в интернет. Обучение востребованным профессиям в сфере IT. Маркетинг. Анализ рынка. Полезные секреты проведения рекламных кампаний. Подпишитесь на нас в социальных сетях, что бы не пропустить важное.

Специальная подборка для Вас